¿Alguna vez has sentido que la Inteligencia Artificial es demasiado lenta para tus necesidades? Imagina un escenario donde un modelo de lenguaje no solo responde rápido, sino que genera tal cantidad de texto que parece instantáneo. No estamos hablando de un vídeo acelerado, sino de una tecnología real que está rompiendo los límites de velocidad actuales: el chip HC1 de la empresa Taalas.

¿Qué es Taalas y cómo logra esta velocidad?

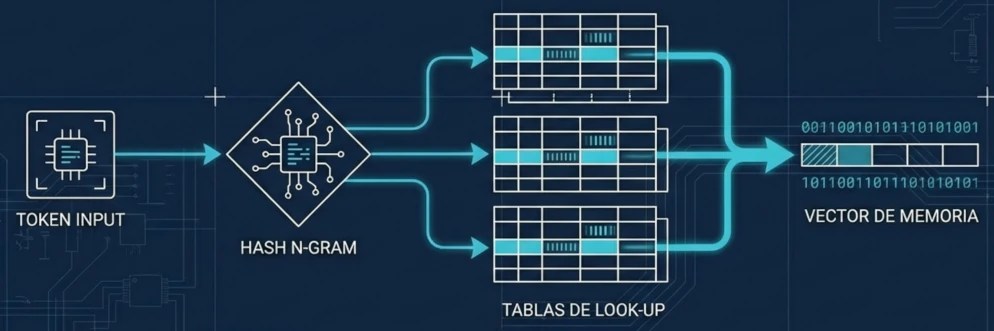

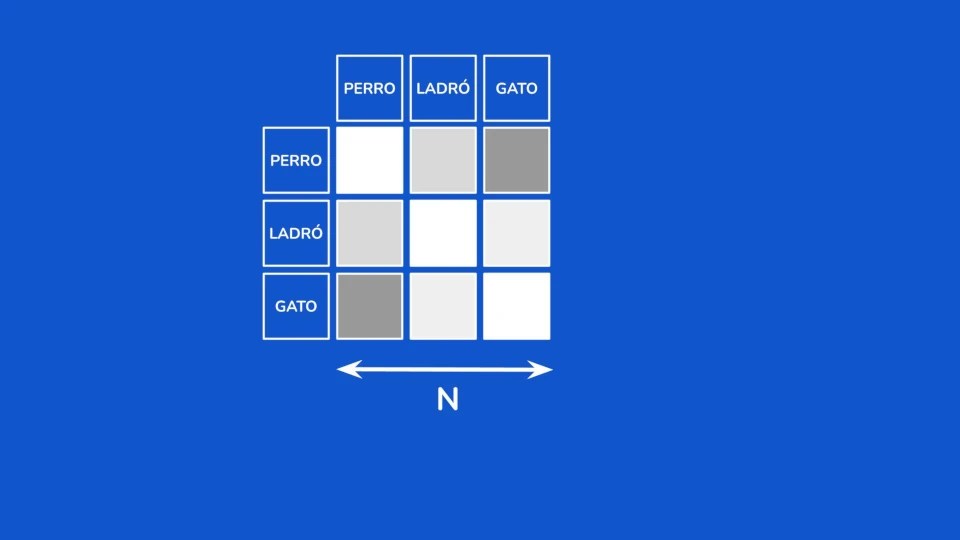

Taalas es una compañía que lleva poco más de dos años trabajando con una visión clara: dejar de depender de arquitecturas de propósito general, como las GPUs, para integrar los grandes modelos de lenguaje (LLM) directamente en el hardware. Mientras que una GPU es extremadamente potente y versátil, no deja de ser una pieza electrónica diseñada para muchas tareas distintas. Taalas, en cambio, ha implementado la arquitectura del modelo de lenguaje directamente en su chip HC1.

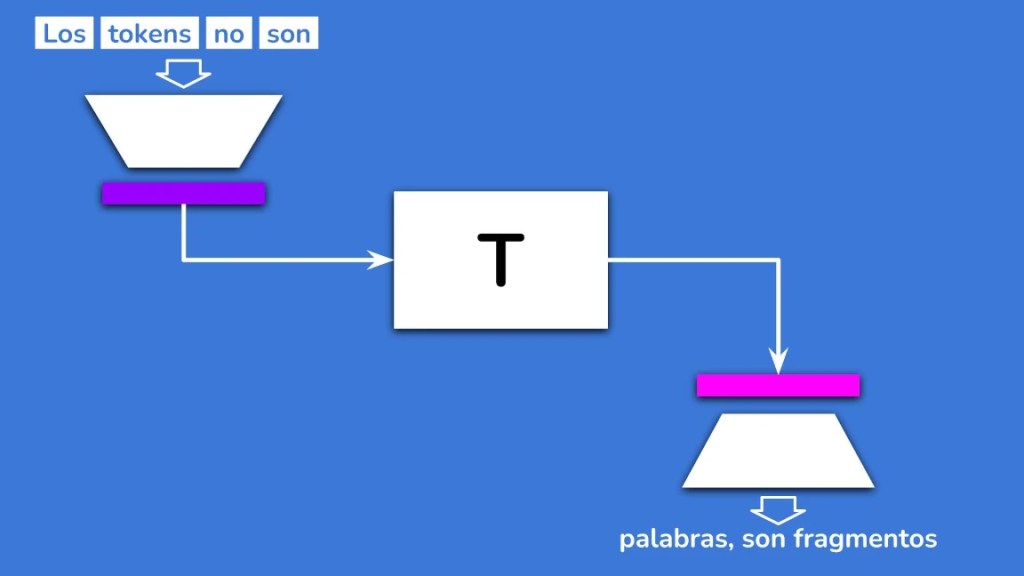

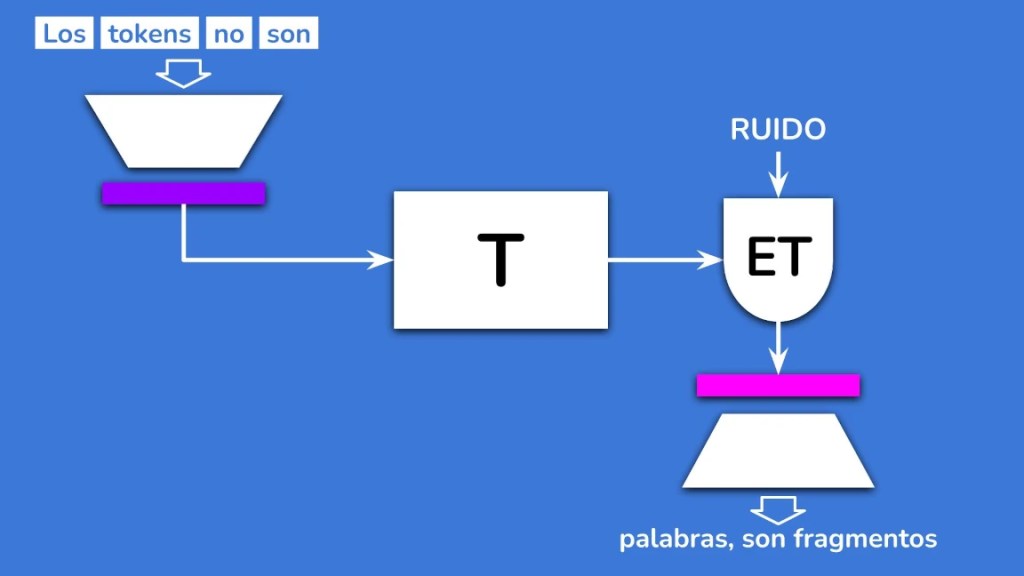

El resultado es asombroso. En demostraciones recientes, se ha visto un modelo Llama 3.1 de 8.000 millones de parámetros funcionando a una velocidad de 17.000 tokens por segundo. Para ponerlo en perspectiva, este sistema es capaz de generar más de 61 millones de tokens en tan solo una hora.

Eficiencia y potencia bajo el capó

Uno de los puntos más interesantes del HC1 es su eficiencia energética. Aunque consume unos 2.500 vatios por hora —una cifra que puede asustar a un usuario doméstico—, si analizamos el consumo por cada token generado, la cifra es ridículamente baja. Es, probablemente, una de las formas más eficientes de procesar lenguaje a gran escala que existen hoy en día.

Sin embargo, para alcanzar estas velocidades, se han tenido que tomar decisiones técnicas importantes:

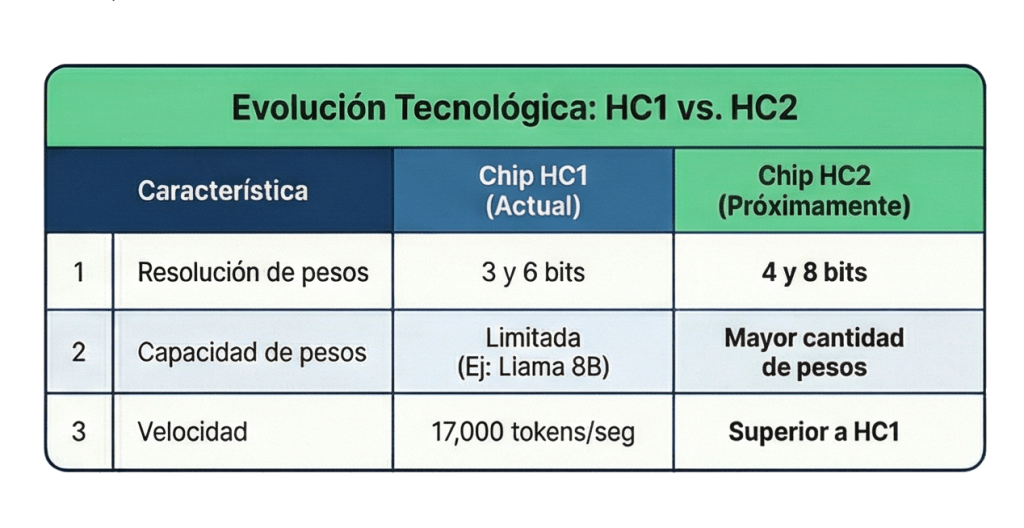

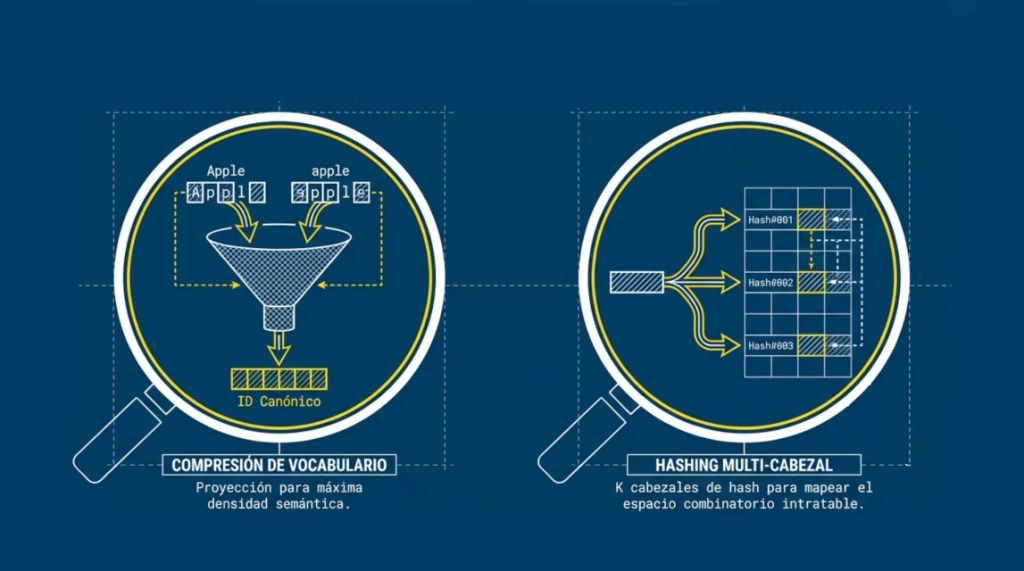

- Cuantización: El chip trabaja actualmente con pesos de 3 y 6 bits, lo que significa que el modelo está comprimido para ajustarse al hardware.

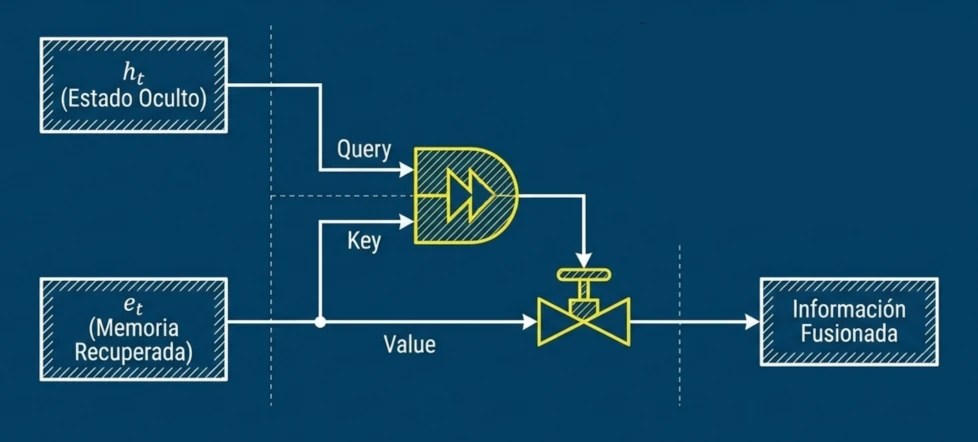

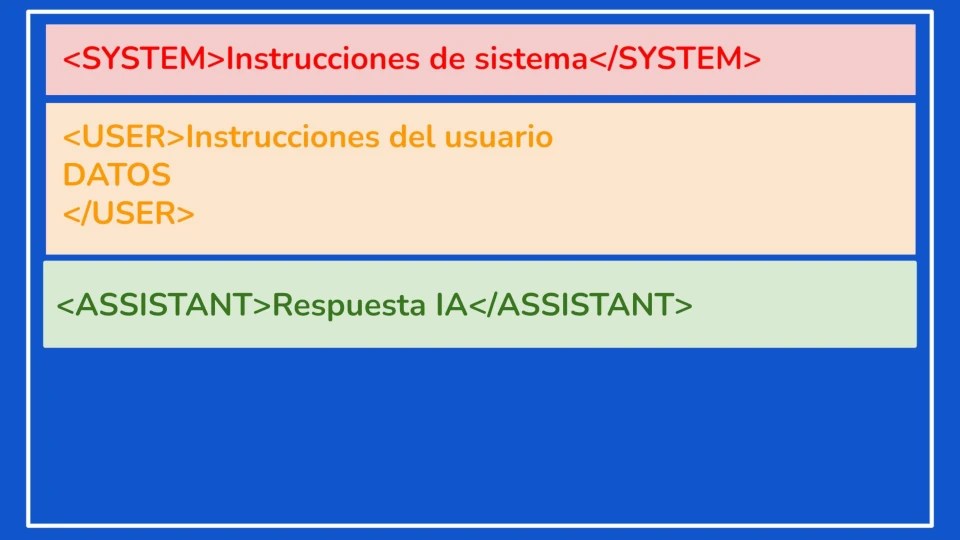

- Flexibilidad limitada: Al estar la arquitectura «grabada» en el chip, no es tan sencillo actualizarlo a la última versión de un modelo que acabe de salir al mercado. Por otro lado, permite modificar los pesos, al menos algunos de ellos, ya que permite usar LoRA.

- Contexto: El tamaño de la memoria de contexto es algo limitado (alrededor de 6.000 tokens), aunque suficiente para una gran variedad de aplicaciones prácticas.

El futuro: El chip HC2 y los modelos razonadores

A pesar de estas limitaciones, como el contexto reducido o la imposibilidad de ejecutar modelos gigantescos de cientos de miles de millones de parámetros, el potencial es enorme. Esta tecnología encaja perfectamente con los nuevos «modelos razonadores». Estos modelos suelen generar una gran cantidad de «pensamientos» internos antes de dar la respuesta final. Con la velocidad de Taalas, ese proceso de razonamiento sería tan rápido que el usuario ni siquiera notaría la espera.

La empresa ya está trabajando en su siguiente evolución, el chip HC2. Se espera que esta nueva versión sea todavía más rápida, soporte una mayor cantidad de pesos y ofrezca una mayor resolución (probablemente pasando a 4 y 8 bits), lo que mejorará la precisión de las respuestas sin sacrificar la velocidad que los hace únicos.

Estamos ante un cambio de paradigma: pasar de ejecutar software de IA en hardware genérico a tener hardware que es la propia IA. La era de los 17.000 tokens por segundo solo acaba de empezar.